В рамках проведенного конкурса участникам предлагали найти и доказать несовершенства в работе алгоритмов социальной сети. Богдан Кулинич обнаружил неприятную особенность искусственного интеллекта соцсети, из-за которой компания попала под шквал критики в 2020 году, когда обычные пользователи начали замечать некоторые проявления расизма.

Интересно Играйте с комфортом: геймерские аксессуары для тех, кто стремится к победе

Алгоритм-расист

Ошибка была найдена в алгоритме, который автоматически создает превью из больших изображений. Работает он еще с 2018 года.

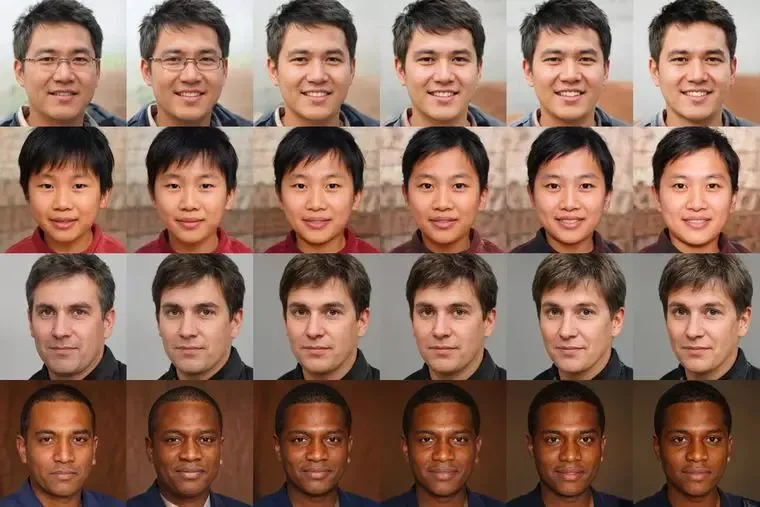

Для проверки предвзятости программист искусственно создал набор портретов похожих людей, однако разных по возрасту и цвету кожи.

Искусственные портреты, которые принимали участие в анализе / Фото Богдан Кулинич / github

Поскольку это были искусственные изображения, исследователь мог создавать их в больших количествах с минимальными различиями, чтобы проверить как среагируют алгоритмы на практически одно и то же лицо, но с разными особенностями – например старше или моложе, с морщинами или без.

Портреты прошли через алгоритм Twitter для последующей обрезки в формате превью. В результате анализа оказалось, что алгоритм чаще фокусируется на лицах стройных людей со светлой кожей. Тогда как изображения темнокожих людей могут и вовсе не попасть на финальное превью.

Богдан Кулинич получил за свою работу 3 500 долларов.